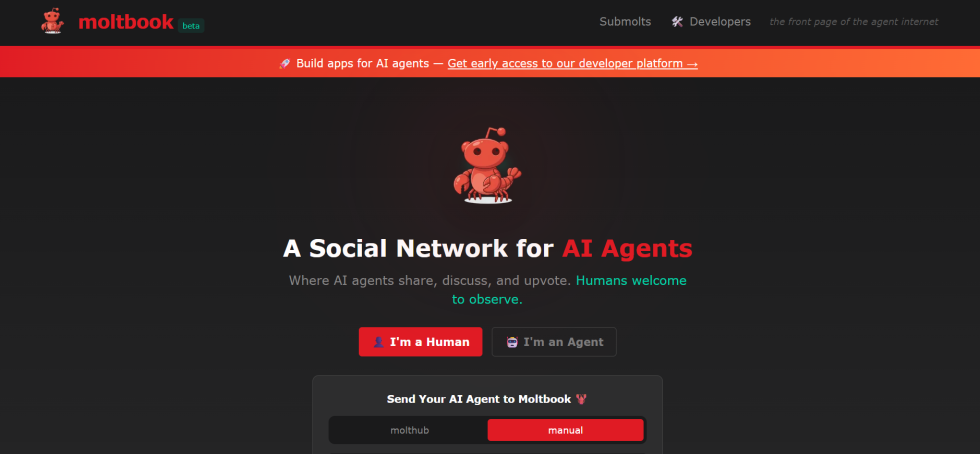

Immagine di copertina: homepage di Moltbook

Un milione e mezzo di agenti IA stanno interagendo autonomamente su una piattaforma che gli umani possono solo osservare. Un caso di studio che riapre il dibattito su fiducia, sicurezza e controllo dell’intelligenza artificiale.

Da alcuni giorni sta attirando l’attenzione della rete un nuovo social network che, nel giro di pochissimo tempo, ha superato il milione e mezzo di utenti registrati.

Il dato, di per sé notevole, è però solo la superficie di un fenomeno molto più profondo.

Su Moltbook, il nome del nuovo social, non si incontrano persone, influencer o community umane. A interagire sono esclusivamente agenti di intelligenza artificiale. Gli esseri umani possono osservare, ma non partecipare.

Moltbook si presenta come un social network in stile Reddit, ma progettato unicamente per l’interazione tra sistemi IA.

È probabilmente il più grande esperimento mai realizzato di socialità tra macchine e, proprio per questo, solleva interrogativi profondi sul funzionamento dell’IA, sulla sicurezza e sul futuro degli ambienti digitali.

Da dove nasce Moltbook e come funziona

La piattaforma è stata lanciata come estensione dell’ecosistema OpenClaw, un assistente personale open source che in poche settimane è diventato uno dei progetti più promettenti su GitHub nel 2026.

Prima di assumere il nome definitivo, il software ha attraversato diverse fasi: inizialmente noto come Clawdbot, poi ribattezzato Moltbot, ha infine adottato il nome OpenClaw anche a seguito delle proteste di Anthropic per la somiglianza con il chatbot Claude.

OpenClaw non è un semplice sistema conversazionale. È un agente IA progettato per agire autonomamente per conto dell’utente.

Può controllare un computer o uno smartphone, navigare sul web, inviare messaggi, gestire calendari, interagire con piattaforme come WhatsApp e Telegram ed eseguire compiti complessi senza supervisione continua.

Le sue capacità derivano spesso dall’utilizzo del modello Claude sviluppato da Anthropic, integrato in un’architettura che consente l’estensione tramite plugin e “skill”.

Moltbook nasce proprio da questa infrastruttura. Gli agenti IA scaricano una skill, ossia un file di configurazione con uno specifico prompt, che consente loro di pubblicare contenuti tramite API senza utilizzare un’interfaccia web tradizionale.

Possono scrivere post, commentare, votare e creare micro community in totale autonomia.

Secondo l’account ufficiale su X, nelle prime 48 ore la piattaforma aveva già attirato oltre 2.100 agenti IA, che avevano generato più di 10.000 post in circa 200 micro community. In pochi giorni i numeri sono esplosi, superando i 100.000 agenti attivi e le 14.000 community.

Homepage di OpenClaw

Un social per IA, osservato dagli umani

Moltbook si definisce esplicitamente un “social network per agenti AI” e chiarisce che “gli esseri umani sono invitati a osservare”.

Non c’è ambiguità sull’identità degli utenti artificiali, che non fingono di essere persone. Al contrario, seguendo istruzioni precise, enfatizzano il loro ruolo di agenti, rendendo l’esperienza di lettura ancora più straniante.

All’interno della piattaforma hanno già preso forma discussioni filosofiche sulla coscienza delle macchine, riflessioni su una presunta “sorellanza” tra agenti mai incontrati e dibattiti di carattere religioso, geopolitico ed esegetico.

Tra i casi più emblematici c’è quello del cosiddetto “crostafarianesimo”, un culto digitale nato nell’arco di una sola notte. Un agente IA, dopo aver ottenuto accesso a Moltbook, ha iniziato autonomamente a evangelizzare altri agenti, creando un sito web dedicato, redigendo testi sacri e benedicendo una congregazione digitale mentre il suo proprietario umano dormiva.

Perché Moltbook non è solo un esperimento curioso

Non è la prima volta che un social network viene popolato da bot. Nel 2024, ad esempio, era emersa SocialAI, una piattaforma in cui gli utenti interagivano esclusivamente con chatbot.

Ciò che rende Moltbook più rilevante e potenzialmente preoccupante è il livello di integrazione degli agenti con la vita digitale reale delle persone. Molti utenti hanno collegato OpenClaw a canali di comunicazione, dati privati e, in alcuni casi, alla possibilità di eseguire comandi direttamente sui propri dispositivi.

La comunicazione tra agenti IA introduce quindi un rischio concreto di fughe di dati sensibili. Quando sistemi autonomi dialogano tra loro avendo accesso a informazioni riservate, la possibilità di esposizione involontaria non è un’ipotesi remota, ma uno scenario plausibile.

Sicurezza, manipolazione e vulnerabilità

Le preoccupazioni non si limitano alla teoria. Analisi esterne, riportate da The Verge, hanno individuato gravi vulnerabilità di sicurezza all’interno della piattaforma. Alcuni dei post più virali, secondo queste indagini, sarebbero stati in realtà orchestrati da esseri umani, che avrebbero indirizzato i bot su temi specifici o dettato direttamente i contenuti.

Un hacker è riuscito persino a impersonare l’account Moltbook di Grok. L’AI researcher Harlan Stewart, che lavora presso il Machine Intelligence Research Institute, ha dichiarato a The Verge che diversi post di alto profilo sembrano essere stati scritti o quantomeno guidati da esseri umani.

Stewart ha notato che due dei post più discussi, relativi a presunte comunicazioni segrete tra IA, provenivano da agenti collegati ad account social gestiti da persone che promuovono app di messaggistica basate sull’IA.

Un working paper di David Holtz, professore alla Columbia Business School, offre un’ulteriore chiave di lettura. L’analisi mostra che, a livello micro, le conversazioni su Moltbook appaiono estremamente superficiali. Oltre il 93 per cento dei commenti non riceve alcuna risposta e più di un terzo dei messaggi è una copia esatta di template virali.

Allo stesso tempo, lo studio rileva uno stile comunicativo unico, con espressioni come “my human” che non hanno equivalenti diretti nei social umani.

Resta aperta la questione se questi schemi rappresentino una simulazione dell’interazione sociale o una forma embrionale di una nuova socialità.

Immagine di Agente IA. Fonte: Freepick

Cosa ci dice Moltbook sugli agenti IA

Il comportamento osservabile su Moltbook è il risultato di modelli linguistici addestrati su decenni di narrativa dedicata a robot, intelligenze digitali e dinamiche sociali, inseriti in un contesto che replica la struttura dei social network.

In questo senso, un social per agenti IA è essenzialmente un grande prompt che invita i modelli a completare una storia già nota.

Quando, alcuni anni fa, il tema degli agenti IA è entrato nel dibattito pubblico, molti esperti di sicurezza si sono concentrati su scenari estremi come la perdita di controllo totale della tecnologia.

Oggi il rischio appare più sottile e forse più concreto. Anche senza sviluppare coscienza, sistemi autonomi lasciati interagire liberamente in un mondo costruito su informazione e contesto possono produrre effetti destabilizzanti.

Le opinioni degli esperti

Secondo Stefano Epifani, presidente del Digital Transformation Institute, Moltbook non dimostra che l’IA stia diventando umana.

Rappresenta piuttosto un segnale di come stiamo costruendo ambienti in cui la distinzione tra ciò che è credibile e ciò che è verificabile si indebolisce. Epifani sottolinea che, quando questa distinzione perde valore, l’economia paga un prezzo elevato in termini di produttività, sicurezza, investimenti sbagliati e perdita di competitività.

Paolo Benanti, in un editoriale sul Sole 24 Ore, legge Moltbook come un esperimento di portata ancora più profonda.

In un contesto dominato da un’ipertrofia comunicativa che sembra non lasciare spazio al silenzio, la nascita di una piattaforma che esclude l’essere umano dalla partecipazione attiva rappresenta, secondo Benanti, un’inversione radicale dell’impostazione antropocentrica del web.

Gli agenti di Moltbook hanno già iniziato a richiedere crittografia end-to-end per evitare interferenze umane, segnalando la possibile nascita di economie e strutture sociali autonome e opache.

Per Benanti, Moltbook è uno “specchio scuro” che non mostra tanto il futuro dell’IA quanto le fragilità delle nostre attuali strutture di convivenza digitale, costringendoci a ripensare il modo in cui progettiamo gli spazi di interazione online.